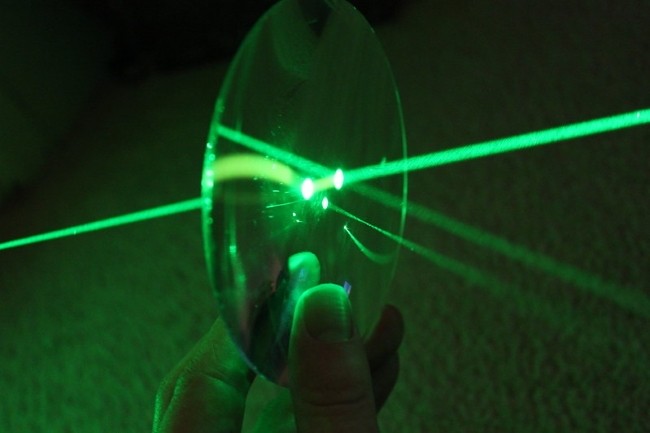

Pirater un assistant vocal par la lumière. C’est ce qu’ont réussi à faire des chercheurs japonais et de l’université du Michigan. Depuis sept mois, ils ont réussi a lancé des commandes à distance sur des assistants Alexa, Siri et Google Home grâce à des faisceaux lumineux et laser. Le diaphragme des micros serait à la fois sensible au son et aux stimulations lumineuses.

D’après une étude de chercheurs japonais et américains, les assistants de Google, Amazon et Apple pourraient être piratés grâce à un faisceau de lumière projeté sur leur micro. (Crédit : Astroshots42/VisualHunt)

La synesthésie est l’association de deux sens : voir des sons, entendre des couleurs, etc. Il semblerait que les assistants vocaux aient cette capacité. Une équipe de chercheurs japonais et de l’université du Michigan a découvert qu’un pirate informatique pourrait coder une commande dans un faisceau lumineux pointé sur le micro d’un assistant vocal domestique pour l’exécuter. Lors de tests, les chercheurs ont, par exemple, pu ouvrir une porte de garage a distance sans prononcer le moindre mot. Ils ont pu prendre le contrôle d’un assistant vocal jusqu’à 110 mètres de distance. En grimpant en haut d’une tour, ils ont également pu pirater un appareil à 70 mètres, le laser traversant une fenêtre.

Tout résiderait dans le diaphragme des micros intégrés aux assistants vocaux. Ce dernier bouge quand un son le percute. Ce qui permet d’envoyer un signal électrique activant la commande voulue. Selon les chercheurs, ce mouvement peut être recréé en agitant un laser ou un faisceau de lumière sur ce diaphragme. Le système y répond comme il répondrait à un son. Ouvrir un garage, allumer et éteindre une lampe avec cette technique serait très simple d’après l’équipe à l’origine de la découverte.

Reconcevoir totalement les micros

Les tests ont été concluants sur des Google Home, et des appareils embarquant Alexa pour Amazon ou Siri d’Apple. Les scientifiques ont alerté les entreprises concernées ainsi que Ford et Tesla, dont les voitures connectées peuvent aussi être attaquées selon eux. Ces groupes ont dit étudier les conclusions de l’équipe, publiées en début de semaine. Cette dernière recommande de totalement revoir la conception des micros de ces appareils pour résoudre le problème.