Soutenue par la fondation Mozilla, la société Mozilla.ai a lancé any-llm v1.0, une bibliothèque Python open source qui fournit une interface unique pour communiquer avec différents fournisseurs de grands modèles de langage.

L’écosystème LLM évolue rapidement avec la parution presque chaque mois de nouveaux modèles et formats d’API. Appuyée par la fondation Mozilla, la société Mozilla.ai annonce la v1 d’any-LLM, une API unifiée basée sur une bibliothèque Python open source. Cette dernière fournit une interface unifiée pour accéder à n’importe quel fournisseur et modèle LLM aussi bien en cloud que local, sans avoir à réécrire une pile à chaque fois. « Cela signifie moins de code passe-partout, moins de casse-tête d’intégration et plus de flexibilité pour choisir ce qui convient le mieux au développeur », indique Nathan Brake, ingénieur ML chez Mozilla.ai, dans un billet de blog. « L’idée est de permettre aux développeurs d’utiliser facilement n’importe quel grand modèle de langage sans être liés à un seul fournisseur ». any-llm a été initialement lancée le 24 juillet dernier.

« La version 1.0 dispose d’une interface API stable et cohérente, d’API async-first et de connexions client réutilisables pour les cas d’usage à haut débit et en streaming », a indiqué M. Brake. Des avis clairs de dépréciation et d’expérimentation sont fournis afin d’éviter les surprises en cas de modification de l’API.

La prise en charge native des complétions par lots dans les tuyaux

La dernière version d’any-LLM a été enrichie des fonctionnalités suivantes :

– Couverture de test améliorée pour plus de stabilité et de fiabilité ;

– Prise en charge de l’API Responses ;

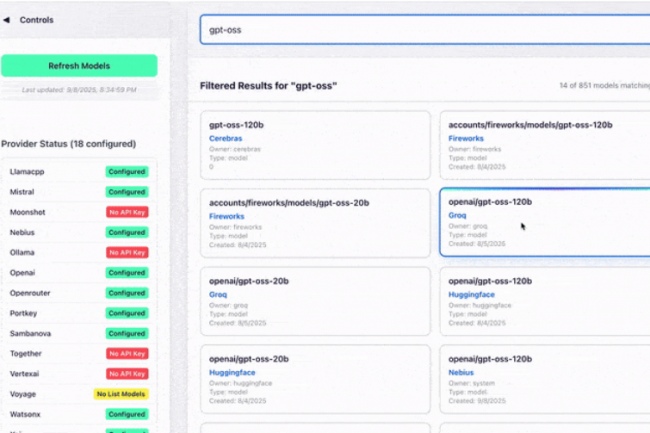

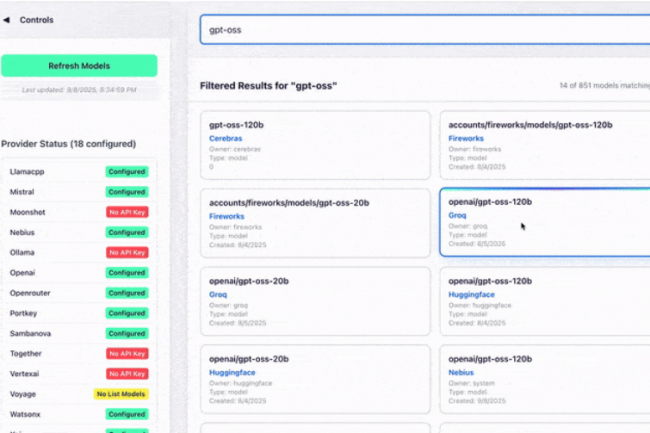

– Ajout d’une API List Models pour interroger par programmation les modèles pris en charge par chaque fournisseur ;

– Connexions client réutilisables pour de meilleures performances ;

– Résultats de raisonnement standardisés pour tous les modèles, ce qui permet aux utilisateurs d’accéder aux résultats de raisonnement LLM quel que soit le fournisseur choisi ;

– Mise à jour automatique de la matrice de compatibilité des fournisseurs, qui indique quelles fonctionnalités sont prises en charge par quels fournisseurs.

Les projets futurs prévoient la prise en charge native des complétions par lots, de nouveaux fournisseurs et des intégrations plus approfondies dans les autres bibliothèques « any-suite » de l’entreprise, notamment « any-guardrail », « any-agent » et « mcpd ».

La version 1.0 d’any-llm a été lancée le 4 novembre. Elle est disponible sur GitHub.